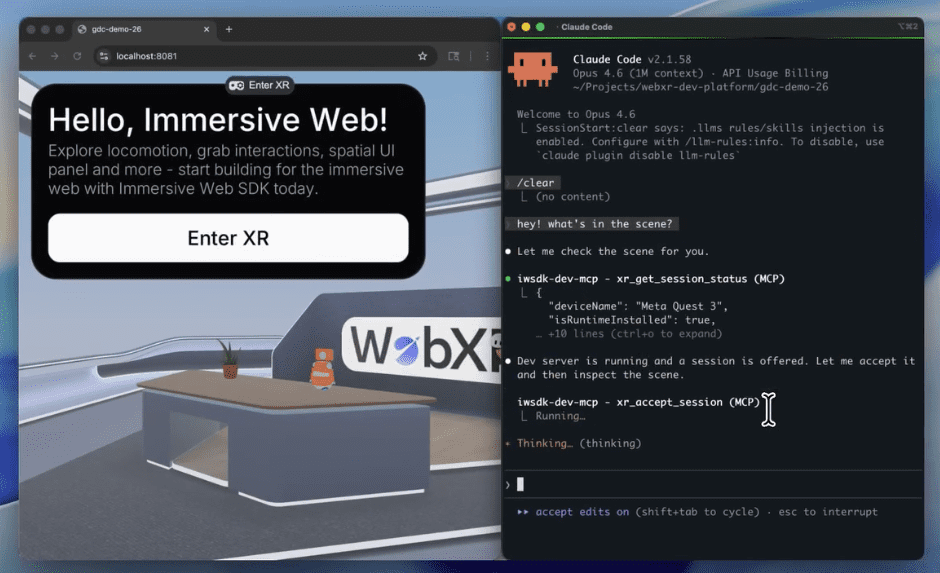

Meta ha presentado nuevas herramientas de desarrollo basadas en inteligencia artificial para su Immersive Web SDK (IWSDK), un kit de desarrollo orientado a facilitar la creación de experiencias inmersivas VR y AR a través de técnicas de programación conocidas como «vibe coding».

El objetivo es claro: reducir las barreras de entrada para que cualquier desarrollador web pueda crear para Meta Quest sin necesidad de dominar motores de renderizado nativos.

Un flujo de trabajo pensado para web

El IWSDK permite desarrollar experiencias inmersivas utilizando herramientas y flujos de trabajo propios del desarrollo web tradicional. Los proyectos se configuran con un único comando, incluyen emulación integrada para probar en el escritorio sin necesidad de un casco y automáticamente proporcionan emulación de teclado y ratón para entornos de navegador convencionales. No hacen falta extensiones ni configuraciones especiales.

IA nativa en el ciclo de desarrollo

Una de las incorporaciones más destacadas es la integración de agentes de inteligencia artificial directamente en el flujo de trabajo. Estos agentes pueden ver, interactuar y depurar escenas WebXR de extremo a extremo mediante 32 herramientas basadas en el protocolo MCP (Model Context Protocol). Esto incluye captura de capturas de pantalla, entrada de controlador, inspección de escena y depuración a nivel de motor.

El sistema funciona con un navegador Chromium gestionado que carga la aplicación y proporciona capturas de pantalla y captura de consola para el agente de IA. Un servidor MCP en tiempo de ejecución expone las herramientas de control del entorno XR emulado, inspección de escena y depuración del estado ECS, mientras el desarrollador puede trabajar manualmente en su navegador normal mientras el agente opera en segundo plano.

Tres modos de trabajo con IA

El IWSDK soporta tres modos de uso optimizados para diferentes flujos de trabajo:

- Agente: La IA opera de forma autónoma en segundo plano sobre un navegador headless con visor de tamaño fijo.

- Supervisión: El desarrollador observa cómo trabaja la IA en tiempo real con un visor visible y redimensionable.

- Colaboración: El desarrollador y la IA comparten la misma sesión con el navegador de Playwright como interfaz principal.

Arquitectura modular

El SDK está construido sobre una arquitectura ECS (Entity Component System) y ofrece sistemas preconstruidos para interacciones de agarre, locomoción, audio espacial, física y comprensión de escena. También incluye integración con UIKit para crear interfaces UI espaciales utilizando sintaxis similar a HTML, compiladas en tiempo de compilación por un plugin de Vite.

Disponibilidad y programa para desarrolladores

El Immersive Web SDK está disponible en acceso anticipado a través de NPM como paquete @iwsdk/core, bajo licencia MIT. Meta también ha lanzado el programa Meta Horizon Start, que ofrece recursos, orientación experta y apoyo para llevar aplicaciones al ecosistema Meta Horizon OS, con una competición dotada con 1,5 millones de dólares en premios para desarrolladores.

Creador de contenido especializado en realidad virtual, realidad aumentada, inteligencia artificial y tecnologías inmersivas. Noticias, análisis y opiniones sobre el mundo de la VR/AR/MR/IA sin perder de vista lo que realmente importa: que la tecnología tenga sentido para quien la usa.

Relacionadas

John Ternus, el nuevo CEO de Apple podría frenar Vision Pro

Bigscreen presenta el nuevo Halo Mount para Beyond 2

Meta Horizon OS 2.3 llega a Quest con pequeñas mejoras