MiniMax ha lanzado M2.7, su nuevo modelo de lenguaje que marca un hito en la industria: es el primer modelo que participa activamente en su propia evolución. La compañía china presentó un sistema que no solo genera código o responde preguntas, sino que construye sus propios arneses de agentes, optimiza sus procesos de aprendizaje y acelera el ciclo de desarrollo de nuevas versiones de sí mismo.

Autoevolución: el modelo que se mejora a sí mismo

El concepto central de M2.7 es la autoevolución. Durante el desarrollo del modelo, MiniMax utilizó una versión interna de M2.7 para actualizar su propia memoria y construir decenas de habilidades complejas en su arnés de agentes. El modelo analizó resultados de experimentos de aprendizaje por refuerzo, identificó áreas de mejora y optimizó su propio proceso de aprendizaje. Esto inicia un ciclo de autoevolución que, según MiniMax, marcará el futuro de la inteligencia artificial.

En un ejemplo concreto, los investigadores asignaron a M2.7 optimizar el rendimiento de programación de un modelo en un andamiaje interno. M2.7 ejecutó de forma totalmente autónoma más de 100 rondas del bucle «analizar trayectorias de fallo → planificar cambios → modificar código del andamiaje → ejecutar evaluaciones → comparar resultados → decidir si mantener o revertir cambios». El resultado: una mejora del 30% en los conjuntos de evaluación internos.

Ingeniería de software a nivel de producción

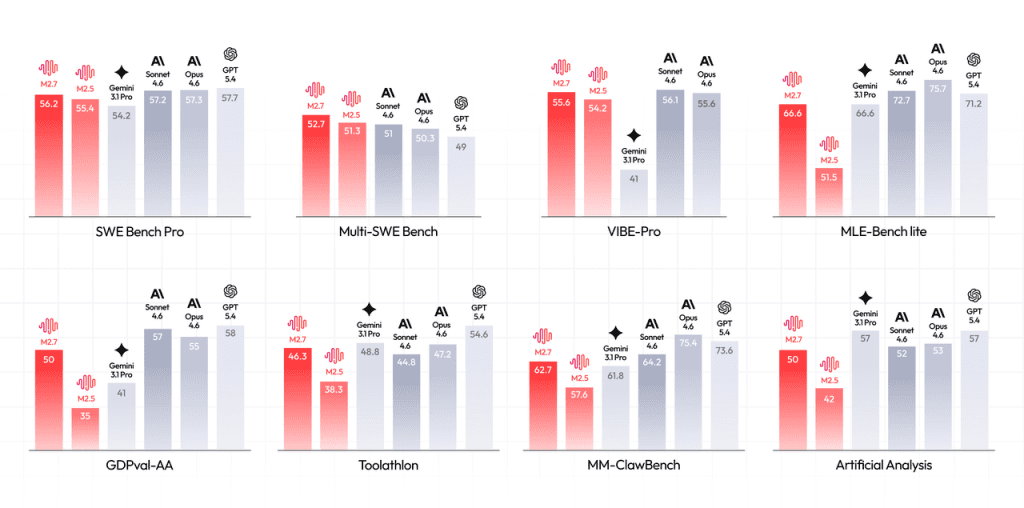

M2.7 alcanza un rendimiento destacado en tareas de ingeniería de software del mundo real. En la referencia SWE-Pro, que cubre múltiples lenguajes de programación, el modelo logró una precisión del 56,22%, casi al nivel de los mejores modelos de alta gama y comparable a GPT-5.3-Codex.

Donde más destaca es en escenarios de producción reales. MiniMax documenta que, al enfrentar alertas en entornos de producción, M2.7 puede correlacionar métricas de monitorización con líneas de tiempo de despliegue para realizar razonamiento causal, analizar datos estadísticos de trazas, proponer hipótesis precisas, conectarse a bases de datos para verificar la causa raíz e identificar archivos de migración de índices faltantes en el repositorio. La compañía afirma haber reducido el tiempo de recuperación de incidentes de producción a menos de tres minutos utilizando M2.7.

En cuanto a entrega de proyectos completos de código, M2.7 obtuvo un 55,6% en la referencia VIBE-Pro, casi al mismo nivel que Opus 4.6. Esto significa que tareas de desarrollo web, Android, iOS o simulación pueden entregarse directamente al modelo para completarlas de extremo a extremo.

Competiciones de aprendizaje automático: oro, plata y bronce

Uno de los datos más llamativos del anuncio: MiniMax sometió a M2.7 a 22 competiciones de aprendizaje automático del nivel MLE Bench Lite de OpenAI, cada una ejecutable en una única GPU A30. El modelo participó de forma totalmente autónoma durante tres pruebas de 24 horas cada una.

Los resultados acumulados: 9 medallas de oro, 5 de plata y 1 de bronce. La tasa media de preseas fue del 66,6%, clasificación solo por detrás de Opus-4.6 (75,7%) y GPT-5.4 (71,2%), empatando con Gemini-3.1. Es la primera vez que un modelo se acerca tanto a los grandes del sector resolviendo competiciones de aprendizaje automático de forma autónoma.

Trabajo profesional: ofimática, análisis e investigación

Fuera del código, M2.7 muestra mejoras significativas en tareas de oficina. En la evaluación GDPval-AA, que mide capacidades profesionales, el modelo alcanzó un ELO de 1495 entre 45 modelos evaluados — el más alto entre todos los modelos de código abierto, por delante de GPT5.3 y solo por detrás de Opus 4.6, Sonnet 4.6 y GPT5.4.

El modelo puede procesar documentos Word, hojas de cálculo Excel y presentaciones PowerPoint con alta fidelidad, realizar múltiples rondas de edición interactiva y producir resultados finales editables. En pruebas internas con más de 40 habilidades complejas (cada una con más de 2.000 tokens), M2.7 mantuvo una tasa de adherencia del 97%.

Un ejemplo práctico: la tarea de modelar los ingresos futuros de TSMC a partir de su informe anual y llamadas de resultados. El modelo leyó de forma autónoma informes anuales y transcripciones de llamadas de conferencia, consultó múltiples informes de investigación, diseñó suposiciones, construyó un modelo de previsión de ingresos y produjo una presentación PowerPoint junto con un informe de investigación — entendiendo, razonando y produciendo como lo haría un analista junior.

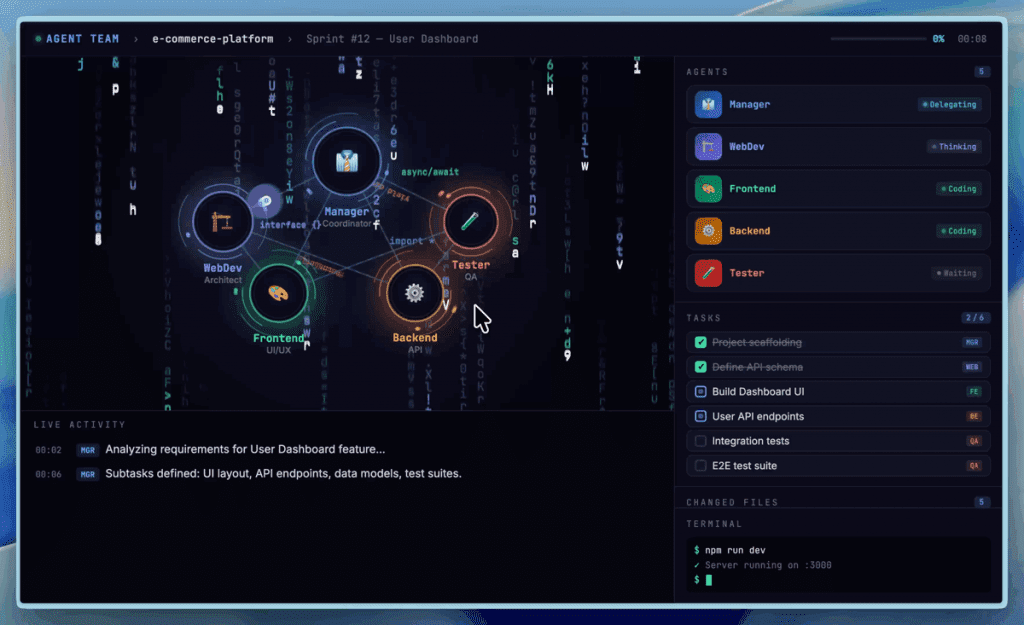

Agent Teams: múltiples agentes colaborando

M2.7 introduce Agent Teams, un sistema de colaboración multiagente que permite que múltiples instancias del modelo trabajen juntas con roles diferenciados. Cada agente mantiene su identidad, desafía los puntos ciegos de sus compañeros y toma decisiones autónomas dentro de máquinas de estados complejas. MiniMax indica que esto no puede lograrse mediante indicación convencional — tiene que ser una capacidad nativa del modelo.

Entretenimiento y personajes interactivos

Además de la productividad, MiniMax ha trabajado en la consistencia de personajes y la inteligencia emocional. La compañía presentó OpenRoom, un demostrador interactivo basado en un arnés de agentes que sitúa las interacciones de IA en un espacio visual web donde todo es interactivo. Las conversaciones impulsan la experiencia, generando retroalimentación visual en tiempo real y permitiendo que los personajes se involucren proactivamente con su entorno.

Disponibilidad

MiniMax M2.7 está disponible desde ahora en MiniMax Agent y la plataforma API de MiniMax. La compañía también ofrece un plan de programación para desarrolladores.

Con M2.7, MiniMax no solo lanza un modelo más potente: lanza un modelo que aprende a ser mejor por sí mismo. El panorama de la inteligencia artificial da otro paso hacia adelante.

Creador de contenido especializado en realidad virtual, realidad aumentada, inteligencia artificial y tecnologías inmersivas. Noticias, análisis y opiniones sobre el mundo de la VR/AR/MR/IA sin perder de vista lo que realmente importa: que la tecnología tenga sentido para quien la usa.

Relacionadas

John Ternus, el nuevo CEO de Apple podría frenar Vision Pro

Bigscreen presenta el nuevo Halo Mount para Beyond 2

Meta Horizon OS 2.3 llega a Quest con pequeñas mejoras