Meta ha presentado Muse Spark, el primer modelo de lenguaje desarrollado por Meta Superintelligence Labs, y lo ha colocado ya como base de la nueva generación de Meta AI. La compañía lo describe como un modelo pequeño y rápido, pero con capacidad suficiente para manejar razonamiento complejo, tareas multimodales y funciones más avanzadas dentro de su asistente.

Qué es Muse Spark y por qué importa

Muse Spark inaugura una nueva familia de modelos con la que Meta quiere construir lo que llama “superinteligencia personal”, es decir, asistentes capaces de ayudar de forma más útil en tareas cotidianas, consultas complejas y flujos de trabajo más amplios. Según la empresa, el modelo ha sido diseñado para priorizar velocidad, eficiencia y capacidad de razonamiento, en lugar de limitarse a inflar tamaño por puro músculo bruto.

Meta asegura además que ha reconstruido su pila de IA durante los últimos nueve meses y que Muse Spark es solo el primer paso de una estrategia escalonada, en la que cada nueva generación validará la anterior antes de dar el siguiente salto.

Así cambia Meta AI con el nuevo modelo

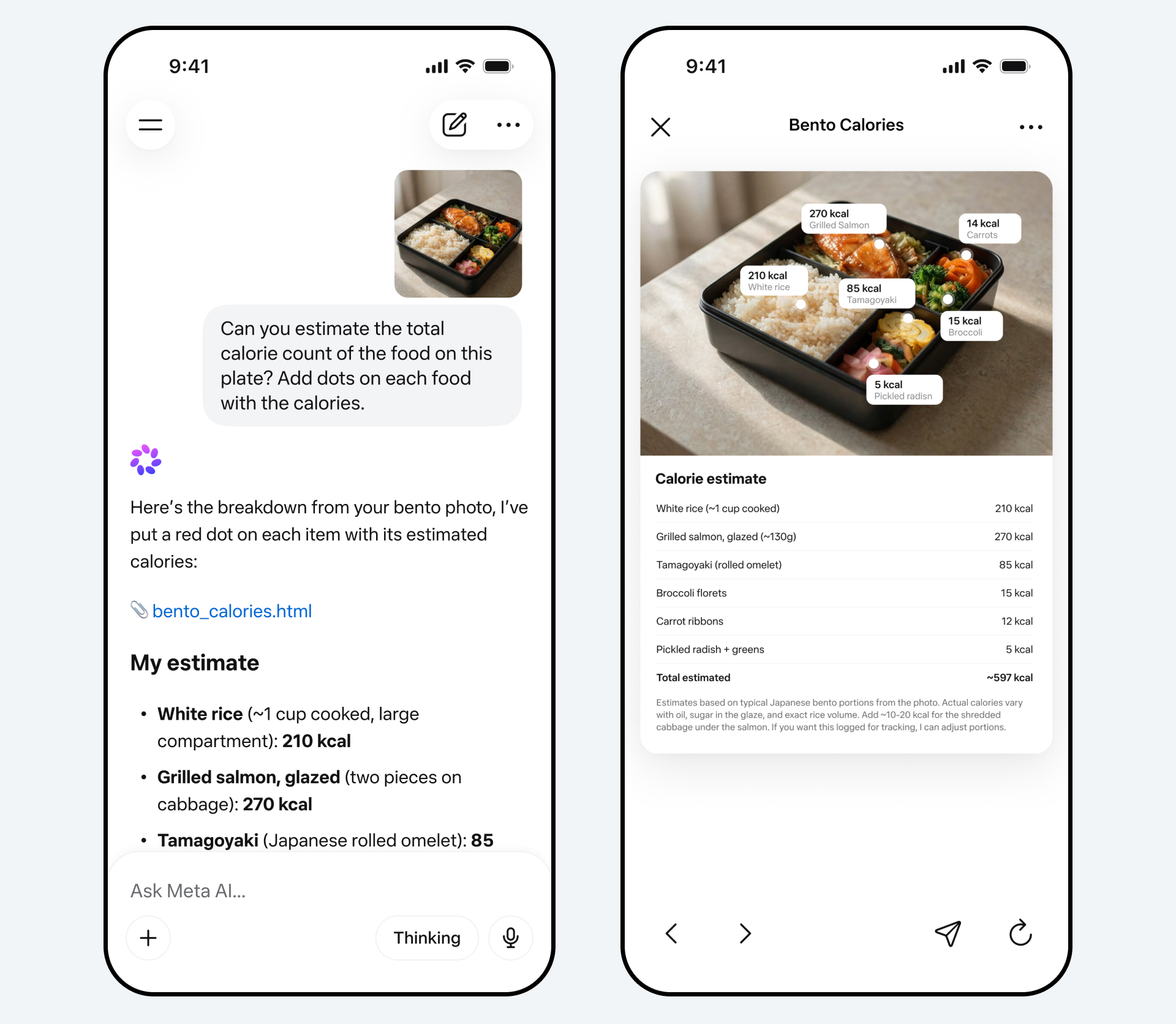

La llegada de Muse Spark no se queda en el laboratorio. El modelo ya impulsa el asistente Meta AI tanto en la app oficial como en meta.ai, con una experiencia renovada y nuevos modos de uso. Entre ellos aparecen un modo instantáneo para respuestas rápidas y otro orientado a razonamiento más profundo.

Uno de los cambios más llamativos es la posibilidad de que Meta AI lance varios subagentes en paralelo para resolver una petición compleja. En la práctica, Meta imagina escenarios donde el asistente divide el trabajo en varias tareas simultáneas, como comparar destinos, organizar un itinerario o buscar actividades relevantes al mismo tiempo.

Más visión, más contexto y foco en salud

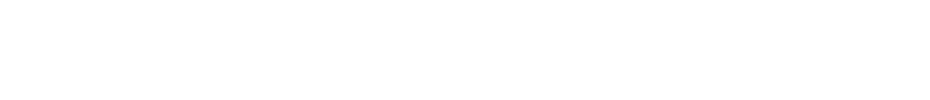

Meta también ha puesto mucho énfasis en la parte multimodal. Muse Spark permite que Meta AI entienda imágenes, productos, gráficas y escenas del mundo real con mayor soltura, lo que abre la puerta a consultas más útiles sin depender solo de texto. La idea es que el asistente pueda “ver” mejor lo que tiene delante, algo especialmente relevante de cara a las gafas inteligentes de la compañía.

Otro de los pilares del anuncio es la salud. Meta afirma haber trabajado con médicos para mejorar la capacidad del modelo a la hora de responder preguntas sanitarias comunes, incluyendo casos en los que intervienen imágenes o gráficos. Es un terreno delicado, así que habrá que ver cómo de fino funciona fuera del discurso corporativo, pero está claro que Meta quiere posicionar esta función como uno de los grandes usos prácticos de su IA.

Compras, búsquedas y generación visual desde el asistente

Además del razonamiento y la visión, Muse Spark también potencia nuevas funciones de compra, descubrimiento y generación. Meta AI podrá sugerir ropa, ideas de estilo, productos o referencias a partir del contenido y las comunidades presentes en el ecosistema de Meta. También promete resultados más ricos cuando se consulten lugares, tendencias o temas populares, apoyándose en publicaciones públicas y contexto social.

La empresa añade que el modelo destaca en programación visual, permitiendo generar desde páginas web sencillas hasta minijuegos a partir de una instrucción. Sobre el papel suena potente, aunque tocará comprobar si esa promesa se traduce en herramientas realmente útiles o en otra demo bonita para enseñar en presentaciones.

Despliegue inicial y planes de apertura

Las nuevas funciones empiezan a desplegarse en Estados Unidos dentro de la app de Meta AI y en meta.ai. Más adelante llegarán a otros países y también a servicios como Instagram, Facebook, Messenger, WhatsApp y las gafas con IA de la compañía. Meta también ha adelantado que la tecnología subyacente se ofrecerá en vista previa privada mediante API a socios seleccionados y que espera abrir futuras versiones del modelo como código abierto.

En resumen, Muse Spark no es solo otro nombre para la colección de modelos de Meta. Es el intento de reordenar toda su estrategia de IA alrededor de asistentes más útiles, multimodales y profundamente integrados en sus plataformas. La ambición es enorme. Ahora falta la parte divertida: ver cuánto hay de producto real y cuánto de humo bien empaquetado.

Creador de contenido especializado en realidad virtual, realidad aumentada, inteligencia artificial y tecnologías inmersivas. Noticias, análisis y opiniones sobre el mundo de la VR/AR/MR/IA sin perder de vista lo que realmente importa: que la tecnología tenga sentido para quien la usa.

Relacionadas

Project Hail Mary tendrá un juego VR y XR

Meta y Unity renuevan su apuesta por el desarrollo XR

Quest 3 estrena Navigator para todos